| name | about | labels |

|---|---|---|

| Bug Report | Use this template for reporting a bug | kind/bug |

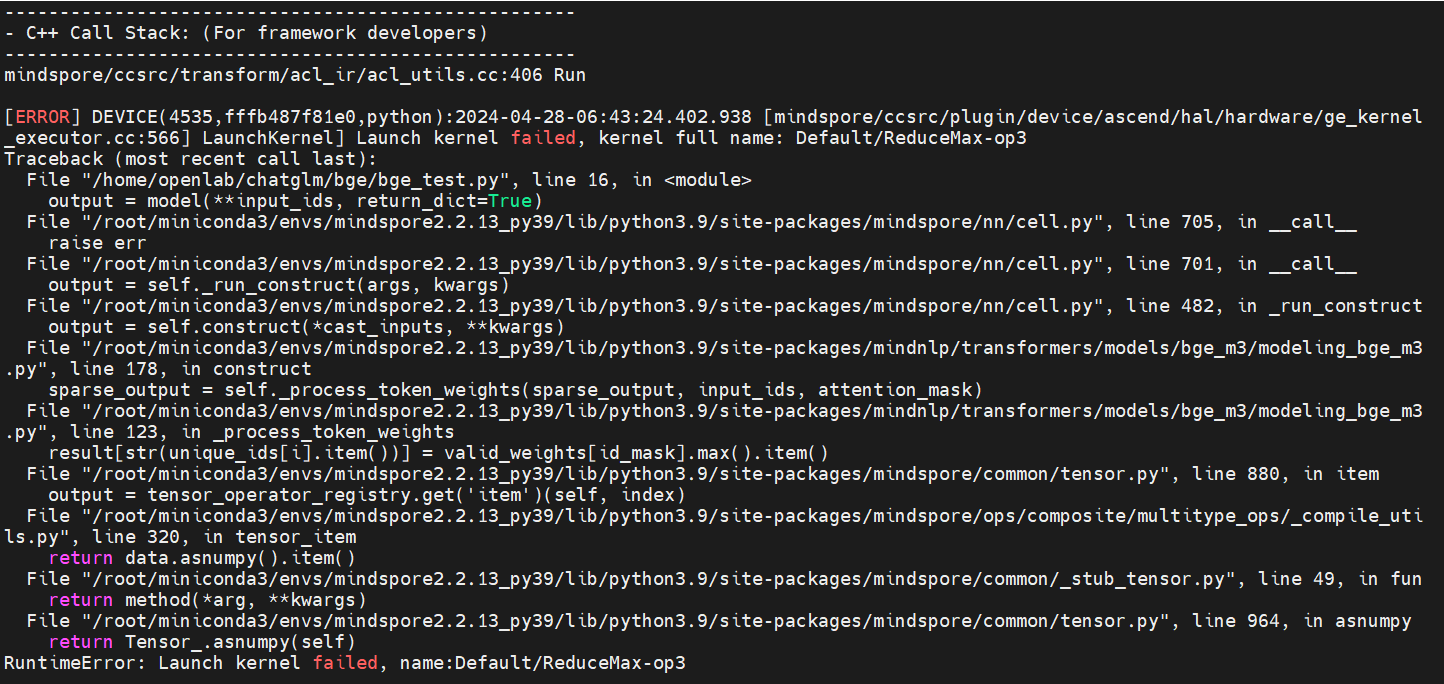

910B切分成32G vnpu,挂载进docker容器,用mindnlp套件执行bge_m3模型推理,reducemax算子编译报错

Ascend/GPU/CPU) / 硬件环境:Please delete the backend not involved / 请删除不涉及的后端:

/device ascend

Software Environment / 软件环境 (Mandatory / 必填):

-- MindSpore version (e.g., 1.7.0.Bxxx) :2.2.13

-- Python version (e.g., Python 3.7.5) :3.9.19

-- OS platform and distribution (e.g., Linux Ubuntu 16.04):ubuntu 20.04

Excute Mode / 执行模式 (Mandatory / 必填)(PyNative/Graph):

/mode pynative

程序正常输出结果

Please assign maintainer to check this issue.

请为此issue分配处理人。

@fangwenyi @chengxiaoli @Shawny

此处可能存在不合适展示的内容,页面不予展示。您可通过相关编辑功能自查并修改。

如您确认内容无涉及 不当用语 / 纯广告导流 / 暴力 / 低俗色情 / 侵权 / 盗版 / 虚假 / 无价值内容或违法国家有关法律法规的内容,可点击提交进行申诉,我们将尽快为您处理。

感谢您的提问,您可以评论//mindspore-assistant更快获取帮助:

已和mindnlp负责人沟通,确认是框架的问题

@tzard 您好 mindnlp的bge_m3目前支持的GPU后端,910B+切分场景暂未支持,建议您联系mindnlp的负责人进行需求评审

@lvyufenghw

登录 后才可以发表评论